전공 성과

- 전공 소식

- 전공 성과

-

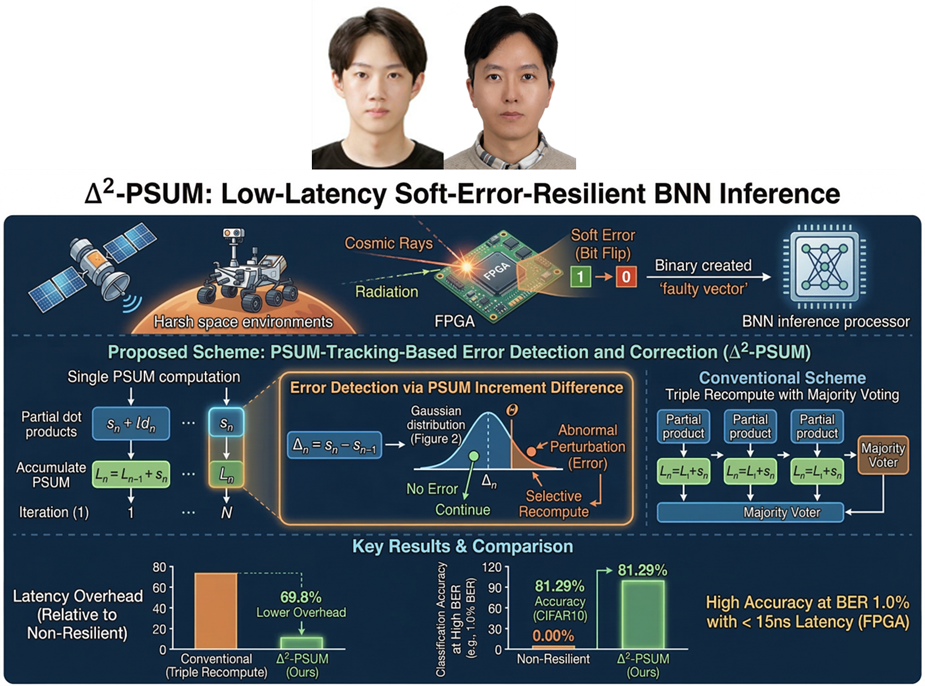

[김태환 교수 연구실] 김태환 교수 연구실의 석사 과정 정새벽 학생의 논문, FPGA 회로 및 시스템 설계 분야 우수 학술대회에 (IEEE Int’l Symp. Field-Programmable Custom Computing Machines) 발표 승인].

2026-03-20 (김지혜)

김태환 교수와 석사 과정 정새벽 학생의 연구 논문이 FPGA 회로 및 시스템 설계 분야의 권위있는 학술 대회 중 하나인 IEEE Int’l Symp. Field-Programmable Custom Computing Machines (FCCM)에 발표 (Oral) 승인되었음. FCCM은 한국정보과학회에서 A급 우수 국제학술대회로 분류되어 있음. 본 연구는 다른 연구 기관 과의 협업 없이 본 연구실 단독으로 진행하여 이룬 성과로, 본 연구실의 높은 연구 역량을 입증하고 있음.

논문의 제목은 “Δ2-PSUM: A Low-Latency Soft-Error-Resilient Binary Neural Network Inference Processor”으로 본 논문은 우주 방사선 등 가혹한 환경에서 발생하는 소프트 에러에 대응하기 위해 고안된 효율적인 이진 신경망 추론 프로세서를 제안함. 해당 프로세서는 부분합 증가량에 급격한 변화가 발생할 때만 선택적으로 재연산을 수행하는 기법을 도입하여, 오류를 수정하면서도 불필요한 연산을 대폭 줄여 매우 짧은 지연 시간을 달성함. 28nm FPGA 하드웨어에서 2.41k LUT라는 아주 적은 자원만으로 구현되었으며, 단 14.57ns 만에 CIFAR10 이미지 하나를 분류할 수 있는 뛰어난 효율성을 보여줌. 결과적으로 1.0%의 높은 BER 환경에서도 정확도 하락을 최소화해 81.29%의 신뢰성 있는 분류 정확도를 유지함으로써, 제한된 하드웨어 자원 내에서 에러 복원력과 연산 효율성을 모두 성공적으로 입증함.

김태환 교수 연구실 (https://cas.kau.ac.kr) 에서는 효율적인 AI 가속기를 위한 Digital VLSI 시스템과 하드웨어를 고려한 AI 모델 최적화와 관련된 다양한 연구를 수행 중이며, 우수 학부 연구생과 대학원생을 상시 모집중임.

-

[김태환 교수 연구실] 김태환 교수와 학부 연구생 3인 (하정원, 이원우, 고태훈)의 논문 회로 및 시스템 설계 분야 Flagship 저널에 (IEEE Transactions on Computer-Aided Design of Integrated Circuits and Systems) 게재 확정].

[김태환 교수 연구실] 김태환 교수와 학부 연구생 3인 (하정원, 이원우, 고태훈)의 논문 회로 및 시스템 설계 분야 Flagship 저널에 (IEEE Transactions on Computer-Aided Design of Integrated Circuits and Systems) 게재 확정].

2026-02-27 (김태환)

김태환 교수와 학부 연구생 하정원, 이원우, 고태훈 학생이 수행한 연구를 기반으로 작성한 논문이 회로 및 시스템 설계 분야의 명실 상부한 Flagship 저널 중 하나인 IEEE Transactions on Computer-Aided Design of Integrated Circuits and Systems에 게재 확정되었다. 본 연구는 다른 연구 기관 과의 협업 없이 본 연구실 단독으로 진행하여 이룬 성과로, 본 연구실의 높은 연구 역량을 입증하고 있음.

논문의 제목은 “Softmex: Lightweight Softmax Compute Engines Based on Exponentiation Units” 으로 AI 모델의 필수적인 연산인 소프트맥스를 계산하는 전용 회로 설계와 관련된 혁신적인 아이디어를 제안하고 있음. 번거로운 사전 정규화와 나눗셈 과정을 수학적 변형을 통해 없애고, 단순한 '지수 계산' 만으로 전체 연산을 처리하는 새로운 계산 알고리즘을 제안하고, 이를 기반으로 하는 고성능 저면적의 소프트맥스 엔진을 디지털 회로로 설계, 구현하여 성능을 평가하였으며, BERT 모델을 기반으로 하는 GLUE Task를 기반으로 수치적인 성능을 검증하였음. 제안하는 소프트맥스 엔진은 기존 세계 최고 연구 결과 대비 4.4배 높은 면적 효율성을 달성하였음.

김태환 교수 연구실 (https://cas.kau.ac.kr) 에서는 효율적인 AI 가속기를 위한 Digital VLSI 시스템과 하드웨어를 고려한 AI 모델 최적화와 관련된 다양한 연구를 수행 중이며, 우수 학부 연구생과 대학원생을 상시 모집중임.

-

이재환 교수 연구팀, AI 데이터센터 CPU 병목 문제 해결 연구 IEEE BigData 2025서 발표

2026-01-13 (김지혜)

우리 대학 컴퓨터공학과 이재환 교수 연구팀이 AI 데이터센터의 CPU 병목 문제를 해결하는 시스템 아키텍처 연구를 IEEE International Conference on Big Data 2025에서 발표했다. IEEE BigData는 빅데이터의 이론, 알고리즘, 시스템 및 응용 분야를 다루는 국제 학술대회로, 올해로 13회를 맞았다.

이번 연구는 우리 대학 컴퓨터공학과 이재환 교수(교신저자, 빅데이터 및 분산 컴퓨팅 연구실)와 석사과정 이유찬 학생이 한국전자통신연구원(ETRI)과 공동으로 수행했다. 연구팀은 AI와 클라우드 컴퓨팅 수요 증가로 데이터센터 환경에서 CPU에 과도한 작업이 집중되며 성능 저하가 발생하는 문제에 주목했다.

연구팀의 논문 <DEPUTY: A DPU-Based Network Offloading Architecture with Minimal CPU Involvement for Stable Network Performance>는 이러한 문제를 해결하기 위해 DPU(Data Processing Unit‧네트워크와 데이터 처리를 전담하는 전용 프로세서)를 활용한 새로운 시스템 구조를 제안했다. 기존 연구들은 CPU 병목을 완화하기 위해 GPU 자원을 추가로 소모하거나, 복잡한 시스템 설정 또는 고가의 장비 도입을 요구하는 한계가 있었다. 이에 연구팀은 CPU가 담당하던 네트워크 처리와 GPU 작업 관리 기능을 분리해 CPU 개입을 최소화하는 방식에 초점을 맞췄다.

GPU(Graphics Processing Unit‧대규모 연산을 병렬로 처리하는 장치)는 AI 학습과 추론 과정에서 핵심적인 역할을 수행하는 연산 자원으로, CPU보다 훨씬 많은 계산을 동시에 처리할 수 있다는 특징이 있다. 그러나 기존 데이터센터 구조에서는 GPU 활용 과정에서도 CPU의 개입이 많아 병목 현상이 발생해 왔다.

연구팀은 네트워크 처리를 DPU로 이전하고, GPU 작업을 CUDA Graph(여러 GPU 연산을 하나의 그래프 형태로 묶어 실행 효율을 높이는 기술) 기반으로 구성함으로써 CPU 개입 없이 동작하는 시스템을 구현했다. 이 방식은 기존 사용자 접근 방식을 그대로 유지할 수 있어 AI 및 클라우드 컴퓨팅 환경 전반에 적용하기 용이하다는 장점이 있다.

실험 결과, 제안된 시스템은 기존 방식 대비 최대 1.96배의 처리량 향상을 보였으며, CPU 부하 없이도 GPU 자원을 효율적으로 활용할 수 있음을 확인했다. 이는 데이터센터 환경에서 시스템 자원 활용 효율을 높이고 안정적인 네트워크 성능을 확보하는 데 기여할 수 있는 성과로 평가된다.

이재환 교수는 “이번 연구는 데이터센터 환경에서 CPU 병목 문제를 해결할 수 있는 새로운 방향을 제시했다”며, “향후 대규모 AI 및 클라우드 시스템에 폭넓게 적용될 수 있을 것으로 기대한다”고 말했다.

-

[김태환 교수 연구실] 이준형 석사과정 학생, 오선희 학부연구생, 회로 및 시스템 설계 분야 Top-Tier 국제학술지에 논문 게재 확정 (IEEE Transactions on Computer-Aided Design of Integrated Circuits and Systems)]

김태환 교수 연구실 (회로 및 시스템 연구실) 에서 이준형 석사과정과 오선희 학부연구생, 김태환 교수가 수행한 연구를 기반으로 작성한 논문이 회로 및 시스템 설계 분야 세계 최고의 국제학술지인 IEEE Transactions on Computer-Aided Design of Integrated Circuits and Systems에 게재 확정되었다. 본 연구는 다른 연구 기관 과의 협업 없이 본 연구실 단독으로 진행하여 이룬 성과로, 본 연구실의 높은 연구 역량을 입증하고 있다.

2025-10-10 (김지혜)

논문의 제목은 “MiniBRNN: A Low-Resource Inference Processor for Binary-Weight Recurrent Neural Networks Based on Speculative Operation Pruning and Interleaved Thread Scheduling”으로, 저전력 / 저자원 AI 추론 프로세서의 설계와 구현을 다룬 연구다. 기존의 순환신경망 프로세서는 연산량과 회로 규모가 커서 엣지 환경에서의 활용에 제약이 있었다. MiniBRNN은 불필요한 연산을 사전에 예측해 생략하는 Speculative Operation Pruning 기법과, 파이프라인 효율성을 극대화하는 Interleaved Thread Scheduling 기법을 조합해, 동일한 성능을 훨씬 적은 자원으로 구현됐다. 기존 ASIC 기반 프로세서 대비 5.13배의 면적 효율 향상을 달성했으며, FPGA 구현에서도 동급 최고 수준의 자원 효율성을 달성했다. 또한 다양한 RNN 기반 작업에서 우수한 추론 성능을 안정적으로 유지했다.

김태환 교수 연구실 (회로 및 시스템 연구실) 은 효율적인 AI 가속기를 위한 Digital VLSI 시스템과 하드웨어를 고려한 AI 모델 최적화와 관련된 다양한 연구를 수행 중이며, 우수 학부 연구생과 대학원생을 상시 모집중이다.

김태환 교수 | taehwan.kim@kau.kr | Circuits & Systems Lab | https://cas.kau.ac.kr -

[회로 및 시스템 연구실 (Circuits & Systems Lab)] 곽길호, 김재호 석사과정, 컴퓨터 시스템 자동 설계 분야 내 최고 권위의 국제학술지에 논문 게재 확정

곽길호(석사 졸업), 김재호(석사 재학) 학생과 김태환 교수가 투고한 논문이 회로 설계 분야 세계 최고 수준의 국제학술지인 IEEE Transactions on Computer-Aided Design of Integrated Circuits and Systems (IEEE TCAD) 2025년 7월호에 게재되었다.

2025-06-30 (관리자)

논문의 제목은 “SR-BIP: A Soft Error-Resilient Binary Neural Network Inference Processor”으로, 이진 신경망의 내재적인 연산 중복성을 이용하여 일시적인 오류에 강건한 인공지능 추론 가속기에 대한 회로 설계와 구현에 대한 연구를 바탕으로 한다. 해당 연구는 높은 신뢰성이 요구되는 자율 주행, 자율 비행과 같은 응용 및 오류 발생 가능성이 높은 극 고온, 우주 환경에서의 인공지능 실현을 가능케 하는 핵심 기술로 사용될 수 있다.

해당 연구는 타 연구 기관 과의 협업 없이 김태환 교수님 지도하에 연구실 단독으로 진행한 것이다. 곽길호, 김재호 학생은 “석사과정 동안 진행한 연구가 값진 결실로 이어져 매우 기쁘고, 세심하게 이끌어주신 교수님의 가르침과 지원에 깊은 감사를 드리고 싶다.”라고 말했다.

김태환 | taehwan.kim@kau.ac.kr | Circuits & Systems Lab | https://cas.kau.ac.kr/